Il 6 dicembre 2022, il Consiglio dell’UE ha adottato la propria proposta con una posizione comune in merito all’AI Act volto ad introdurre una regolamentazione europea di sistemi di intelligenza artificiale (AI).

Con l’AI Act, il legislatore europeo prosegue nell’incentivare la digitalizzazione dell’Europa, attraverso la creazione di uno spazio digitale sicuro per cittadini e imprese, assicurando che tali sistemi rispettino diritti fondamentali e valori alla base dell’Unione.

Iter legislativo e target della proposta di AI Act sull’intelligenza artificiale

L’obiettivo di rendere l’Unione europea un hub mondiale per l’intelligenza artificiale necessita di fiducia nella capacità dei sistemi di intelligenza artificiale di rispettare i diritti fondamentali e valori europei. Questo sentimento di fiducia si sostanzia nell’accertare che i sistemi di intelligenza artificiale siano rispettosi delle normative in materia, eticamente corretti e tecnicamente validi.

In linea con questo target, la Commissione europea aveva reso pubblica, già nell’aprile scorso, una bozza della propria versione dell’AI Act. Il documento è stato oggetto di analisi da parte di Consiglio e Parlamento europei, da cui la proposta legislativa resa nota dal Consiglio, con modifiche volte a chiarirne e semplificarne la messa in circolazione. La normativa sui sistemi di intelligenza artificiale si rivolge tanto ai produttori, definiti come “qualsiasi persona fisica o giuridica, autorità pubblica o altro organismo che sviluppi o faccia sviluppare un sistema di intelligenza artificiale”, quanto agli utenti finali, individuati in “qualsiasi persona fisica o giuridica che utilizzi un sistema di intelligenza artificiale sotto la propria autorità”.

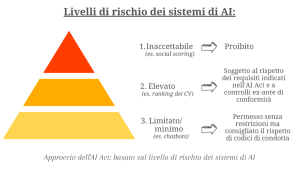

L’approccio adottato nell’atto distingue i sistemi di intelligenza artificiale sulla base del livello di rischio che comportano, suddividendoli in

- livello di rischio inaccettabile, e quindi proibito, come il social scoring;

- livello di rischio elevato a cui si rivolge la normativa proposta, come gli strumenti di analisi e ranking dei CV dei candidati nell’ambito di un colloquio di selezione; e

- livello di rischio limitato o minimo, come i chatbots, i quali sono semplicemente incoraggiati ad aderire a codici di condotta volontari.

Spetta ora alle negoziazioni tra Parlamento e Consiglio europeo trovare un terreno di accordo comune per l’adozione del documento ufficiale.

Quali sono i principali elementi di novità dell’AI Act rispetto alla precedente bozza

Le modifiche apportate dal Consiglio dell’UE alla precedente proposta di AI Act volta a introdurre una normativa europea sull’intelligenza artificiale sono volte a rendere il quadro giuridico chiaro e dal taglio pratico, con un focus sul miglioramento della governance e dell’applicazione effettiva della normativa.

- Definizione di sistema di intelligenza artificiale: per facilitare la distinzione tra AI e sistemi software più semplici, la proposta del Consiglio restringe e ne precisa la definizione, facendo riferimento a “sistemi sviluppati mediante approcci di apprendimento automatico e approcci basati sulla logica e sulla conoscenza.”

- Pratiche di intelligenza artificiale vietate: il divieto di utilizzare i sistemi di intelligenza artificiale per il social scoring (rientrante nel livello di rischio inaccettabile) viene esteso anche ai privati. A ciò si aggiunge l’inclusione di coloro che si trovano in condizioni di vulnerabilità a causa delle proprie condizioni economiche e/o sociali all’interno della categoria di attività per cui è vietato l’uso di intelligenza artificiale.

- Classificazione dei sistemi di intelligenza artificiale come “livello di rischio elevato” e relativi requisiti: i requisiti per i sistemi di intelligenza artificiale ad alto rischio sono stati chiariti per risultare di più semplice e meno gravosa attuazione (ad esempio facendo riferimento alla documentazione che le PMI dovranno redigere per conformarsi alle disposizioni dell’atto). Maggiori indicazioni interessano anche l’assegnazione di ruoli e responsabilità all’interno della catena del valore in cui i sistemi di intelligenza artificiale sono inseriti, articolando il rapporto tra le indicazioni dell’AI Act e la normativa già in vigore (ad esempio per il settore dei servizi finanziari).

- Sistemi di intelligenza artificiale per finalità generali: nuove disposizioni disciplinano gli usi dei sistemi di intelligenza artificiale per finalità generali (i.e. per svariati scopi) e danno conto altresì della possibilità di integrare tali sistemi per finalità generali all’interno di un sistema di intelligenza artificiale ad alto rischio. La previsione del Consiglio è di assicurarsi che tali sistemi di intelligenza artificiale per finalità generali rispettino gli stessi requisiti imposti ai sistemi ad altro rischio, tramite un atto di esecuzione risultante da una valutazione d’impatto ad hoc.

- Conformità dell’applicazione e sorveglianza del mercato: le finalità militari, di difesa e sicurezza nazionale sono state esplicitamente escluse dal perimetro applicativo dell’AI Act. L’utilizzo di sistemi di intelligenza artificiale per finalità di ricerca e sviluppo e gli obblighi di persone che utilizzano tali sistemi per scopi non professionali sono stati parimenti esclusi (ad eccezione degli obblighi di trasparenza). Tenuto inoltre conto delle peculiarità proprie delle autorità di contrasto, e fatte salve le relative tutele, alcune modifiche sono state altresì introdotte per dare atto della “necessità di rispettare la riservatezza dei dati operativi sensibili in relazione alle loro attività”.

- Procedure di valutazione della conformità e comitato per l’AI: nell’obiettivo di semplificare il quadro di conformità della normativa sull’AI e la vigenza delle norme nel contesto del mercato unico europeo, la proposta del Consiglio semplifica e chiarisce come valutare la conformità rispetto all’atto sui sistemi di intelligenza artificiale. Viene data inoltre maggiore autonomia al comitato che si occupa della governance rispetto alla normativa sull’AI. A ciò si aggiunge l’obbligo per detto comitato di “istituire un sottogruppo permanente che funga da piattaforma per un’ampia gamma di portatori di interessi”.

- Sanzioni ridotte per le PMI: la proposta del Consiglio riduce il massimale delle sanzioni amministrative comminabili alle PMI e alle start-up per violazioni dell’AI Act.

- Trasparenza: l’aumento della trasparenza per i sistemi di intelligenza artificiale ad altro rischio rientra tra le modifiche apportate rispetto al testo della Commissione, prevedendo un obbligo di registrazione nella banca dati dell’UE per sistemi di intelligenza artificiale ad alto rischio per utenti-entità pubbliche di tali sistemi (con particolare riguardo per i sistemi di riconoscimento delle emozioni, per cui è introdotto un obbligo di informativa per i soggetti che vengono esposti a sistemi di questo tipo). Il testo del Consiglio chiarisce inoltre che è possibile per gli interessati proporre reclamo all’autorità competente in tema di conformità alla normativa sull’AI.

- Sandboxes a sostegno dell’innovazione: per permettere uno sviluppo fondato su studi in un quadro esperienziale reale e derivarne un sistema giuridico migliorato, la proposta introduce misure a sostegno dell’innovazione. In particolare, “spazi di sperimentazione normativa” permetteranno di testare i sistemi di intelligenza artificiale nella quotidianità, senza controlli ed in presenza di condizioni e garanzie di favore.

Criticità e prospettive dell’AI Act

Come il Regolamento Europeo per la Protezione dei Dati Personali (GDPR) nel 2018, così il pacchetto di misure che i legislatori europei stanno progressivamente rilasciando in tema di intelligenza artificiale ha il potenziale per divenire uno standard globale. A causa delle diverse criticità ancora presenti nelle proposte legislative sull’intelligenza artificiale, la proposta di AI Act necessita di ulteriori revisioni volte ad assicurare che i sistemi di intelligenza artificiale siano utilizzati per scopi positivi, in un clima di fiducia da parte di coloro che devono affidarsi agli output di tali sistemi intelligenti.

L’Italian Digital SME Alliance (associazione ponte tra le aziende digitali italiane e le istituzioni europee) ha raccolto le voci delle piccole e medie imprese che verrebbero impattate dagli obblighi di compliance previsti nella proposta. Nonostante il plauso all’iniziativa europea di regolamentare il quadro di sviluppo ed innovazione dei sistemi di intelligenza artificiale, alcune criticità emergono, quali ad esempio la necessità di riconsiderare la classificazione dei rischi presentati da tali sistemi. Alcune AI considerate “ad alto rischio” sono infatti vietate, lasciando tuttavia spazio a “omissioni e scappatoie”. L’auspicio è di “affrontare adeguatamente i rischi reali e futuri dell’IA in base al rischio complessivo per la società e i diritti fondamentali”. Ed è proprio rispetto alla tutela di diritti e valori fondamentali che l’intervento umano di supervisione di tali sistemi gioca ancora un ruolo cruciale nello scandagliare l’operato dell’intelligenza artificiale.

Sempre sullo stesso argomento, può interessarvi Proposte della normativa europea sulla responsabilità per intelligenza artificiale ed era digitale (dirittoaldigitale.com).